En los últimos días estaba buscando datos para escribir sobre un tema que abordado antes: dudar de todo lo que se ve, lee y escucha debido al impacto que está produciendo la inteligencia artificial (IA) en la producción de contenidos.

Al respecto en septiembre pasado escribí:

La inteligencia artificial está tomando casi todo los espacios posibles en diversas áreas de contenidos digitales, por lo que se hace necesario adoptar un hábito saludable ante su aparición. Mi consejo al respecto es: duda de la respuesta.

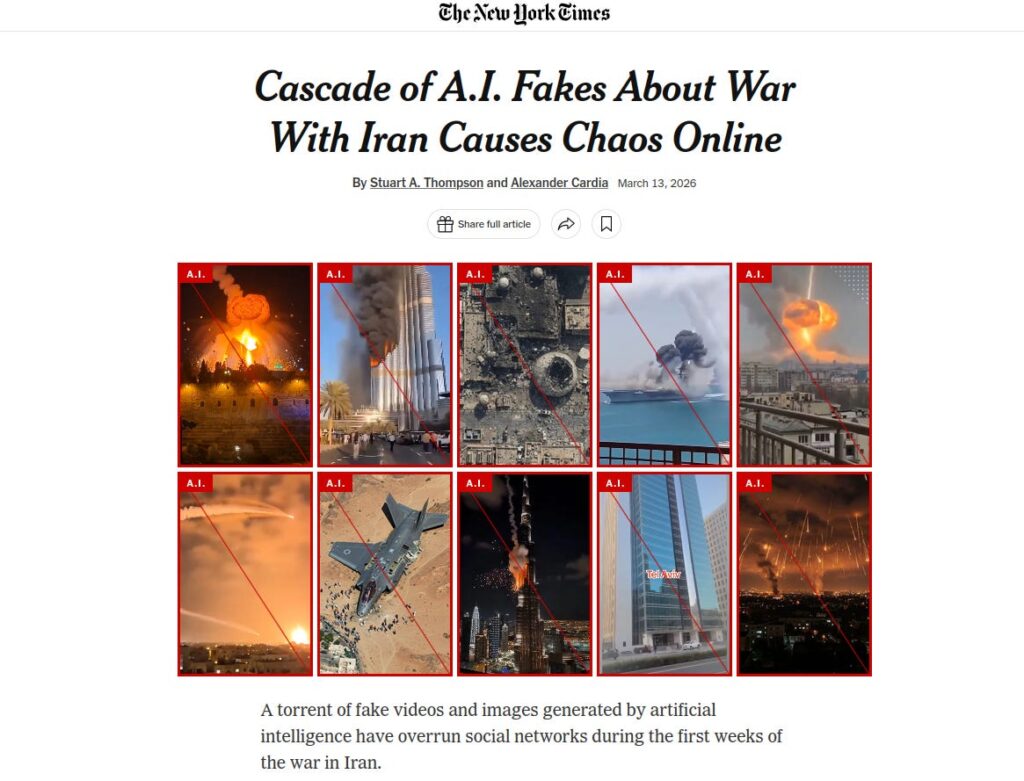

Entonces, como comentaba, había llegado a conseguir buenos ejemplos para usarlos en esta columna. Un ejemplo es este artículo de The New York Times que habla de cómo los videos creados con inteligencia artificial están inundando la narrativa de la guerra que hace Estados Unidos en Irán. O el esfuerzo que hace el primer ministro israelí para demostrar que está vivo, luego que un video oficial mostrara que en una de sus manos se veían seis dedos (un error típico de las creaciones con IA).

Evidencia en Chile

Pero todo cambió ayer, cuando una publicación local se tomó las redes: la zanja en el norte que el gobierno actual está planeando construir para cumplir con su plan en torno a la inmigración ilegal, se hizo dueña de las noticias. En particular, de quienes están enfocados a mostrar las falsedades de algunas publicaciones a través de ese noble oficio que es el chequeo de los hechos o fact-checking.

Aprovecho de destacar en este sentido el buen trabajo de Mala Espina, sitio al que sigo regularmente, que verificó la información de la zanja, seguido por el comentario en el sitio de Turno, proyecto noticioso con el sello de Nicolás Copano.

Es muy claro que se hace necesario cumplir con ciertas directrices acerca del uso de la IA en la generación de contenidos noticiosos, anunciando en todo momento que se emplea esta tecnología para simular la realidad, cuando ese sea el caso. Si no se hace, lo único que va a ocurrir es que se va a perder la confianza de la audiencia. Y eso, es lo opuesto a lo que cualquier medio quiere producir.

La tarea entonces —como dije, para cualquier medio— es mejorar la gobernanza de la producción de contenidos para que este tipo de casos no llegue a producirse. De lo contrario, será como Pedrito anunciando la noticia que viene el lobo: muy pronto nadie te va a creer.

BBC: dos ideas

Para cerrar esta entrega me gustaría poner como ejemplo lo que está haciendo la BBC. Por un lado está su política oficial acerca del uso de la IA en la producción de contenidos. Allí se explica, por ejemplo, que el uso para la creación de imágenes no es adecuado:

El uso de herramientas de IA para crear imágenes puede ser considerado cuando no desafía el significado editorial del contenido, distorsiona el significado de los eventos, altera el impacto del material original o lleva a la confusión en la audiencia.

Por otro lado, toma cartas en el asunto a través de su sitio BBC Verify en el que hace el trabajo de verificación de publicaciones que están circulando, entregando una versión real e informada de lo que ocurre. A mi juicio, allí es donde está la real potencia de los medios en este tiempo.